Ferret AI多模态大语言模型是什么

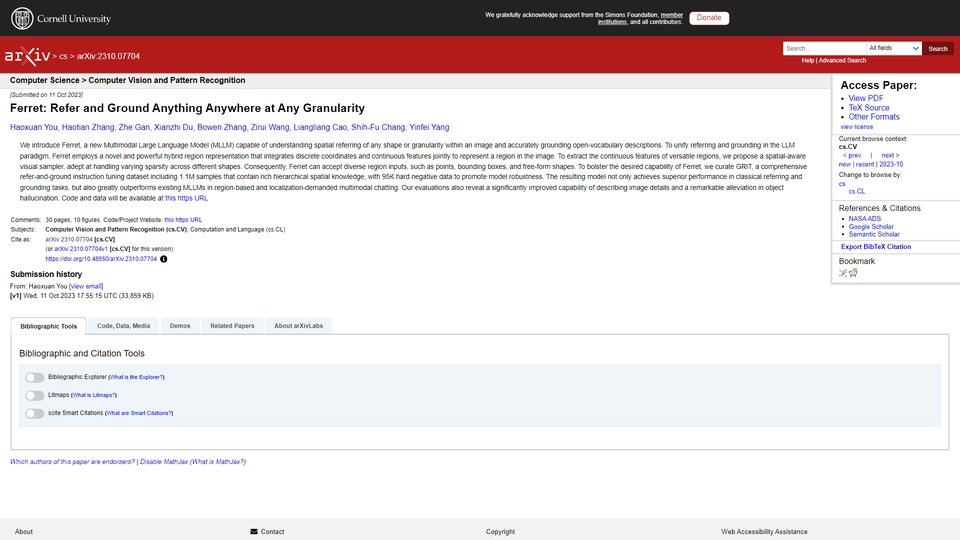

多模态大语言模型(MLLM)是一个由苹果公司开发的新型模型,兼具图像理解和语言处理的强大能力。此产品的推出旨在解决传统模型在多模态信息处理方面的不足,尤其是在理解空间指示方面表现卓越。苹果公司,作为全球领先的科技公司,不仅在硬件领域享有盛誉,也在持续拓展其在人工智能领域的影响力。

这款多模态大语言模型的核心在于其对图像和文本信息的联合处理能力。传统的模型通常需要分别处理文字和图像信息,然后再集成分析,而这款新型模型通过先进的自然语言处理和计算机视觉技术,能够更有效地理解两种形式的信息。尤其在需要理解图像中的空间关系、物体定位以及进行复杂指令解析的场景中,该模型展现了无与伦比的优势。

在当今日益依赖于多模态数据的科技环境中,这种技术的突破意味着在许多应用场景中都有广阔的前景。例如,自动驾驶、智能家居系统、机器人导航和虚拟现实技术等领域都可能受益于此类模型的进步。对需要处理复杂视觉和语言任务的行业而言,这一产品具有重要意义。

使用这种模型的直接受益者可能包括人工智能开发者、计算机视觉研究人员、科技公司以及任何需要进行复杂多模态数据分析的企业。通过提供更强大的分析能力和更精确的理解能力,这一创新无疑将在未来几年推动相关领域的快速发展。

Ferret AI多模态大语言模型功能

Ferret是Apple推出的新型多模态大语言模型(MLLM),它在图像理解和语言处理方面表现出色,尤其在理解空间参考方面展现出显著优势。以下是关于Ferret的一些核心功能描述。

多模态理解

Ferret能够同时处理和理解图像和文本信息。这种能力使得它可以在多个不同的应用场景中展现出优异的性能。

- 图像理解: Ferret能够分析和解释图像内容,识别图像中的物体、场景以及细节特征。

- 语言处理: 在语言处理方面,Ferret擅长自然语言理解和生成,能够通过上下文理解文本意图。

卓越的空间参考理解

Ferret在空间参考理解方面具备独特的优势。它能够有效捕捉和解释文本中涉及空间关系和方位的描述,例如描述物体的相对位置。

- 空间关系解析: 例如,“在桌子的左侧有一个红色苹果”,Ferret能够将语言中复杂的空间关系映射到视觉任务中。

- 动态场景理解: 在包含动态或复杂场景的任务中,能够准确处理和推断物件的位置和关系。

性能指标

Ferret在多模态任务中的性能指标表现卓越,这使其成为图像和文本混合任务的理想选择。

- 高效处理:在典型的多模态评测中展示出高效的处理能力。

- 准确性: 在复杂的图像-文本配对任务中,Ferret的准确率普遍高于大多数同类模型。

用户受益

Ferret为用户提供了全新的交互方式,使得信息提取和应用变得更加智能和高效。

- 提高生产力: 通过简化复杂信息的提炼过程,用户能够快速获取所需内容。

- 多应用扩展: 适用于教育、科研、娱乐等多场景,为用户提供了广泛的应用可能性。

通过这些功能,Ferret不仅在同类产品中脱颖而出,还为多模态技术的进一步发展奠定了基础。它的多模态处理能力将为行业带来更多创新应用。

Ferret AI多模态大语言模型常见问题

Ferret AI多模态大语言模型 常见问题

什么是Apple的多模态大语言模型(MLLM)?

Apple的多模态大语言模型(MLLM)是一种能够同时处理图像理解和语言处理的AI模型,尤其在理解空间引用方面表现出显著优势。

Apple的多模态大语言模型有什么主要功能?

该模型的主要功能包括图像和文本的联合分析、空间关系的理解及应用在各种实际场景中的多模态信息处理。

如何使用Apple的多模态大语言模型(MLLM)?

具体的使用方法通常随产品推出附带的用户手册提供,用户可以根据指引将其应用于需要图像和语言共同处理的任务当中。

Apple的多模态大语言模型有哪些优势?

这个模型的优势在于能够同时理解和处理多种数据模式,特别是在处理空间引用和复杂交互时表现优秀,从而在图像和语言的结合领域提供更高效的解决方案。

Apple的多模态大语言模型的价格是多少?

目前有关Apple多模态大语言模型的定价信息尚未公布,建议关注Apple官方发布的最新公告以获得准确信息。