Cos'è AI Ferret

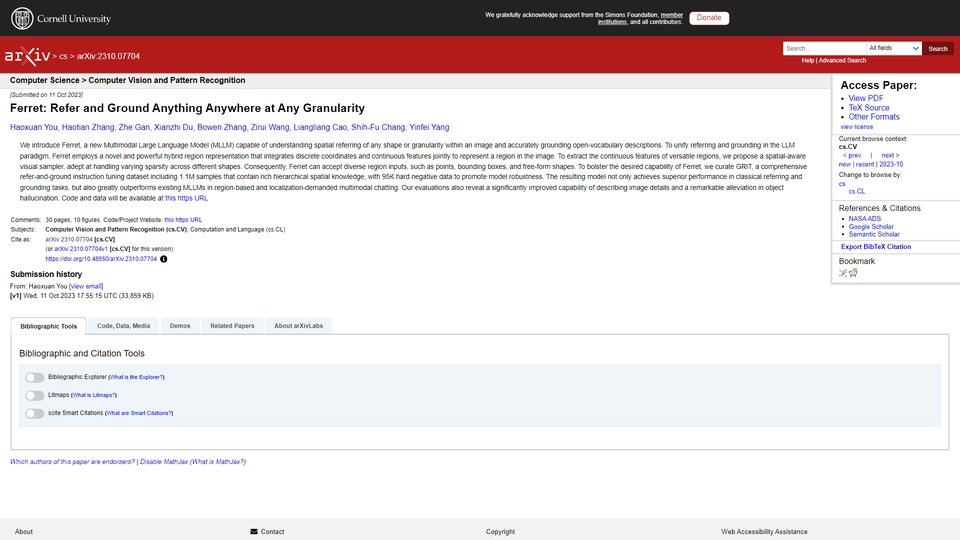

Nel mondo in continua evoluzione dell'intelligenza artificiale, Apple ha sviluppato un nuovo tipo di modello di linguaggio multimodale (MLLM) che sta segnando un passo avanti nel campo della comprensione delle immagini e dell'elaborazione del linguaggio. Questo prodotto innovativo dimostra particolari vantaggi nella comprensione dei riferimenti spaziali, una sfida comune ma complessa nell'analisi di immagini e nel contesto linguistico.

Sfruttando le avanzate capacità di AI, l'approccio di Apple integra l'elaborazione dei dati visivi e testuali per migliorare la precisione e l'efficacia delle interazioni, rendendolo particolarmente utile nelle applicazioni che richiedono un'interpretazione accurata dei contesti visivi e verbali complessi. Il modello trova la sua forza nell'elaborazione multimodale, permettendo una comprensione più profonda e sfumata che va oltre le capacità dei tradizionali modelli linguistici.

Questo progresso è cruciale per settori come la realtà aumentata, le applicazioni di assistenti digitali e la robotica, dove la comprensione contestuale è essenziale. Professionisti del settore tecnologico, ricercatori e sviluppatori possono trarre grande beneficio dall'integrazione di questo nuovo modello nei loro progetti per migliorare le soluzioni AI esistenti o innovare nuove applicazioni. Con questo strumento, Apple non solo alza il livello della tecnologia AI, ma ridefinisce le possibilità di interazione tra macchina e ambiente.

AI Ferret Caratteristiche

AI Ferret è un prodotto che integra un modello di linguaggio multimodale di grandi dimensioni, sviluppato da Apple, che eccelle nell'elaborazione e comprensione delle immagini e del linguaggio. Ecco alcune delle funzionalità chiave di AI Ferret:

Funzionalità principali

AI Ferret utilizza un modello multimodale che riesce a comprendere e analizzare simultaneamente dati visivi e testuali. Questo aspetto permette al sistema di estrarre informazioni da immagini e testi, fornendo risposte coerenti e contestuali. Tale capacità è particolarmente utile in contesti dove testi e immagini sono strettamente correlati.

Capacità di automazione

Grazie alla sua capacità di comprensione del linguaggio naturale e delle immagini, AI Ferret è in grado di automatizzare vari processi che richiedono l'interpretazione di dati multimodali. Questa automazione si traduce in un risparmio di tempo significativo per gli utenti che lavorano con dataset complessi e variegati.

Vantaggi chiave rispetto ai concorrenti

AI Ferret si distingue per la sua competenza nella comprensione delle referenze spaziali. Questa caratteristica fornisce un vantaggio competitivo rispetto ad altri modelli di elaborazione del linguaggio naturale che potrebbero non gestire adeguatamente le relazioni spaziali tra gli oggetti nelle immagini.

Pubblico target e casi d'uso

Il sistema è ideale per professionisti in campi come l'analisi di dati visivi, lo sviluppo di applicazioni basate su AI e la ricerca accademica, specialmente per chi ha bisogno di strumenti che possano combinare l'elaborazione di immagini e testi in modo avanzato ed efficiente.

L'uso di grafici potrebbe aiutare a visualizzare i vantaggi prestazionali di AI Ferret rispetto ai suoi concorrenti e la sua capacità di gestire le referenze spaziali.

AI Ferret Domande Frequenti

AI Ferret Domande Frequenti

Cosa è un modello multimodale di linguaggio ampio (MLLM)?

Un MLLM è un modello di intelligenza artificiale che può elaborare e comprendere diversi tipi di dati, come immagini e testi, combinando capacità di visione artificiale e elaborazione del linguaggio naturale.

Quali sono i vantaggi del nuovo MLLM di Apple?

Il nuovo MLLM di Apple eccelle nella comprensione delle immagini e nell'elaborazione del linguaggio, mostrando vantaggi significativi nella comprensione dei riferimenti spaziali.

Come funziona la comprensione dei riferimenti spaziali in questo MLLM?

Il modello è in grado di interpretare la relazione tra oggetti nello spazio, migliorando la comprensione delle descrizioni linguistiche e la corrispondenza con le immagini.