O que é Ferret IA

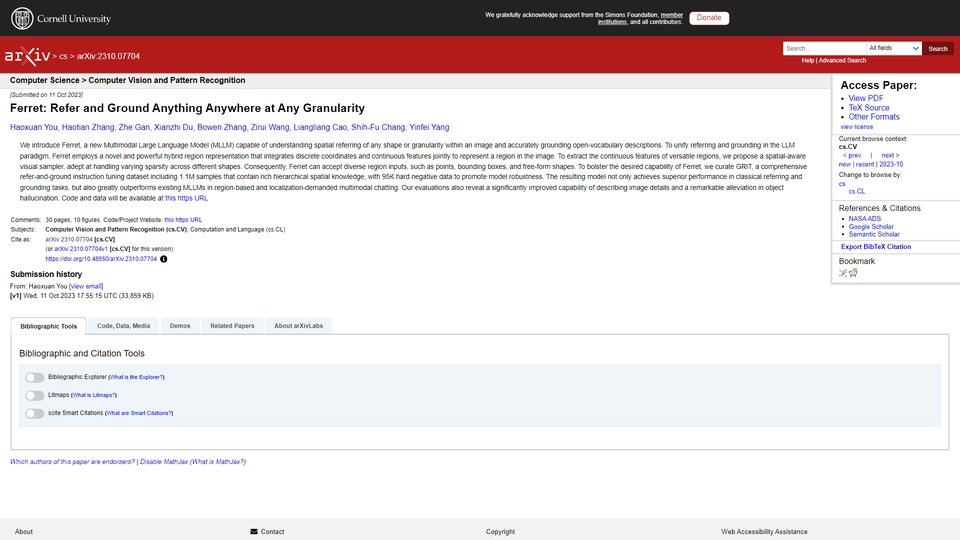

O Ferret é um avançado modelo de linguagem multimodal (MLLM) desenvolvido pela Apple, destacando-se na compreensão de imagens e processamento de linguagem. Projetado para melhorar a forma como sistemas de IA interpretam referências espaciais, o Ferret atende a uma necessidade crítica no campo da IA: a integração eficaz de dados visuais e textuais. Essa tecnologia é especialmente relevante para indústrias que dependem de análises complexas de imagens e interpretação de linguagem, como segurança, saúde e tecnologia assistiva.

Com sua capacidade de processar informações visuais e textuais de forma coesa, o Ferret oferece uma solução robusta para ambientes onde a compreensão contextual de imagens e texto é vital. Ele se diferencia por sua competência em decodificar referências espaciais, algo que tem desafiado muitos modelos anteriores. Este avanço coloca o Ferret em uma posição de destaque no mercado de inteligência artificial, oferecendo benefícios significativos para desenvolvedores, pesquisadores e empresas que buscam soluções de interpretação multimodal.

A Apple, reconhecida por suas inovações tecnológicas, reforça seu compromisso com a IA ao lançar o Ferret. Este modelo não só expande as fronteiras do que é possível em termos de processamento de linguagem e visão, mas também abre novas possibilidades para aplicações futuras em várias verticais do mercado. Como ferramenta, o Ferret promete transformar a maneira como a tecnologia interage com o mundo ao nosso redor, proporcionando insights mais profundos e interações mais naturais.

Ferret IA Recursos

O produto de IA Ferret é um modelo de linguagem grande multimodal (MLLM) desenvolvido pela Apple que se destaca no entendimento de imagens e processamento de linguagem. A seguir, são apresentados alguns dos recursos e aspectos principais deste modelo:

Funcionalidades Principais

O Ferret é projetado para oferecer um excelente desempenho em tarefas que envolvem tanto a compreensão de imagens quanto o processamento de linguagem natural. Essa capacidade multimodal permite que ele interprete referências espaciais de maneira significativamente mais eficaz do que outros modelos, o que é essencial para aplicações que requerem uma combinação de informações visuais e textuais.

Benefícios para os Usuários

Entre os principais benefícios para os usuários, o Ferret proporciona uma compreensão mais integrada e coesa de informações visuais/textuais. Isso é especialmente útil em áreas como:

- Criação de Conteúdo Multimídia: Onde a coerência entre imagem e texto é fundamental.

- Pesquisa e Inovação: Facilitando a interpretação de dados complexos que combinam texto e imagem, possibilitando novas descobertas.

Pontos Únicos de Venda

Um dos aspectos únicos do Ferret é sua habilidade para interpretar referências espaciais com maior precisão. Essa competência melhora significativamente a interação humano-computador em contextos visuais, tornando-o uma ferramenta poderosa para desenvolvedores e criadores de conteúdo que buscam integrar inteligentemente imagens e texto.

Caso de Uso e Público-Alvo

O modelo é voltado para profissionais em tecnologia e áreas que exigem análise avançada de dados visuais e textuais. Em pesquisas científicas, como estudos cosmológicos ou visão computacional, o Ferret pode servir como uma ferramenta crucial para análise de dados, oferecendo insights mais detalhados e precisos.

Ferret IA Perguntas Frequentes

Ferret IA Perguntas Frequentes

O que é o novo modelo de linguagem multimodal da Apple?

O novo modelo de linguagem multimodal (MLLM) da Apple é um sistema avançado que combina capacidades de compreensão de imagens com processamento de linguagem, especialmente eficiente em entender referências espaciais.

Quais são as vantagens do MLLM da Apple?

O MLLM da Apple oferece vantagens significativas na compreensão de referências espaciais, o que melhora a interpretação de posições, direções e contextos em que elementos visuais aparecem juntamente com o texto.

Como o MLLM da Apple pode ser aplicado?

Este modelo pode ser utilizado em aplicações que exigem integração de visão computacional e linguagem, como realidade aumentada, assistentes pessoais e sistemas de navegação que necessitam de orientações detalhadas e precisas.