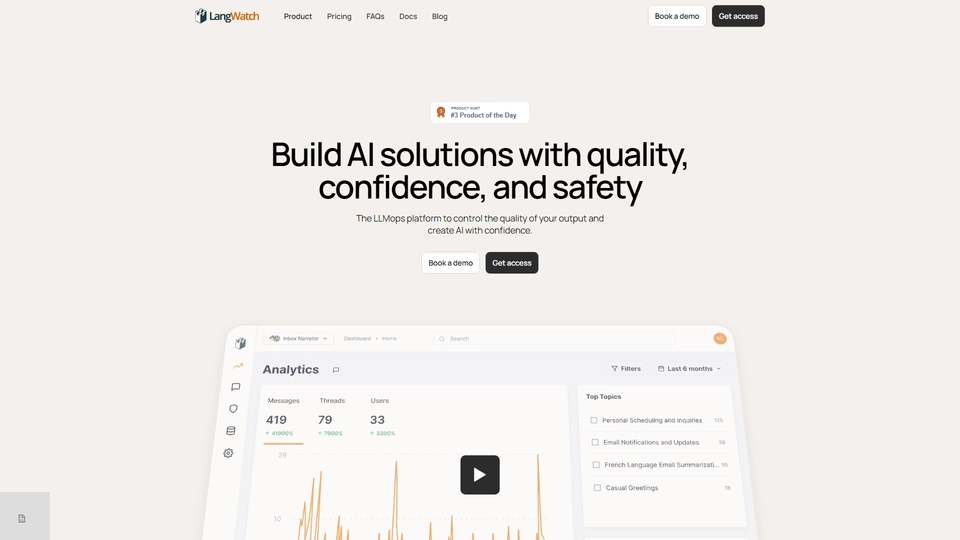

Wat is LangWatch AI

LangWatch is een geavanceerd, open-source platform dat is ontwikkeld door een enthousiast team uit Amsterdam. Het biedt een intuïtieve manier om bestaande Generatieve AI-pijplijnen te verbeteren en de risico's van AI, zoals jailbreaking, gevoelige datalekken en hallucinaties, te beperken. Met de lancering op Product Hunt, positioneert LangWatch zich als een essentieel hulpmiddel voor productteams en zakelijke leiders die streven naar optimalisatie van GenAI-productprestaties.

Geboren uit de ervaring en passie voor het bouwen van generatieve AI-tools, biedt LangWatch niet alleen een venster naar gebruikersinteracties, maar ook naar diepgaande inzichten. Hiermee wordt een einde gemaakt aan het zwarte doos-effect, waardoor beslissingen op basis van heldere data mogelijk worden. Het platform is ontworpen om zowel niet-technische gebruikers als technische experts te ondersteunen, zodat ze hun producten effectief kunnen managen en verbeteren.

De technologie achter LangWatch richt zich op het verhogen van de kwaliteit van AI-interacties door inzicht te bieden in waar de modellen mogelijk hallucineren. Dit stelt bedrijven in staat om potentiële problemen vroegtijdig te identificeren en aan te pakken, waardoor de veiligheid en betrouwbaarheid van hun AI-oplossingen worden gegarandeerd. Doelgroepen zoals productteams, AI-ontwikkelaars en zakelijke beslissers kunnen aanzienlijk profiteren van de mogelijkheden die LangWatch biedt, zeker in een tijd waarin AI-innovatie centraal staat.

LangWatch AI Functies

LangWatch is een open-source platform dat zich richt op het verbeteren van LLM-pijplijnen en het verminderen van risico's zoals jailbreaking en hallucinations. De belangrijkste functies van LangWatch omvatten:

Risicobeperking

LangWatch biedt tools om veiligheidsrisico's in AI-oplossingen te verminderen. Dit omvat het identificeren en corrigeren van mogelijke hallucinations in AI-modellen, wat de algehele kwaliteit van de output verbetert. Daarnaast houdt het toezicht op kwetsbaarheden zoals jailbreaking, wat voorkomt dat kwaadwillenden het systeem manipuleren.

Gegevensverwerking en Analyse

Het platform stelt productteams en zakelijke leiders in staat om gedetailleerde gebruikersinteractie-analyse uit te voeren. Deze functionaliteit helpt bij het bieden van inzichten die verder gaan dan de traditionele blackbox-benadering van AI, waardoor betere beslissingen kunnen worden genomen op basis van concrete gegevens.

Aanpassingsmogelijkheden

LangWatch maakt het eenvoudig om aanpassingen door te voeren in bestaande LLM-pijplijnen. Dit helpt teams om snel iteraties uit te voeren en hun AI-oplossingen te verbeteren door gebruikers- en domeinexpertfeedback te integreren.

Voordelen voor de gebruiker

Gebruikers profiteren van een transparanter AI-systeem dat niet alleen beter presteert maar ook is opgebouwd om aan hun specifieke behoeften te voldoen. De inzichten die het platform biedt, helpen bij het optimaliseren van AI-productprestaties en bieden een betere gebruikerservaring door het voldoen aan en overtreffen van verwachtingen.

LangWatch is een waardevolle tool voor bedrijven die willen dat hun GenAI-producten veiliger, efficiënter en gebruiksvriendelijker zijn.

LangWatch AI Veelgestelde Vragen

LangWatch AI Veelgestelde Vragen

What is LangWatch.ai?

LangWatch.ai is an open-source platform designed to improve and iterate on LLM pipelines while mitigating risks such as jailbreaking, sensitive data leaks, and hallucinations in AI models.

How does LangWatch.ai help mitigate AI hallucinations?

LangWatch.ai provides insights and analytics that help identify where AI models are likely to hallucinate, allowing users to optimize responses and improve model reliability.

What are the main features of LangWatch.ai?

LangWatch.ai offers tools for optimizing GenAI product performance, providing insights for decision-making, and safeguarding against vulnerabilities like jailbreaking and data leaks.

Ontdek alternatieven voor LangWatch AI

ZeroTrusted AI Guard beschermt uw gegevens met zero-trust beveiliging, waardoor ultieme privacy en veiligheid worden gegarandeerd.

7-11-2024

GPTGuard AI biedt geavanceerde bescherming en privacy voor AI-systemen met innovatieve maskeringstechnologie.

3-11-2024